IA générative : nouvelle arme pour les cyberattaquants ou atout pour la cybersécurité des organisations ?

L’IA générative est au cœur de l’actualité et a envahi progressivement notre quotidien, notamment à la suite de l’apparition de ChatGPT. Suscitant à la fois craintes et enthousiasme, elle est aujourd’hui déjà utilisée dans de nombreux secteurs d’activité : santé (pose de diagnostics plus rapide, personnalisation des plans de traitement…), éducation (création de plans d’apprentissage personnalisés…), développement de logiciels (débogage facilité, génération et production d’extraits de code) …

Mais qu’entend-on par IA générative ? Le centre canadien pour la cybersécurité propose cette définition : « L’IA générative est un type d’intelligence artificielle qui génère du nouveau contenu en modélisant les caractéristiques des données tirées des grands jeux de données qui alimentent le modèle. Alors que les systèmes d’IA traditionnels peuvent reconnaître les modèles ou classifier le contenu existant, l’IA générative peut créer du nouveau contenu sous plusieurs formes, comme du texte, une image, un fichier audio ou du code logiciel. »

Les cyberattaquants n’auront pas attendu longtemps avant d’utiliser l’IA générative à leur compte : de nombreux modes opératoires d’attaque (MOA) ont rapidement adopté cet outil pour compromettre leurs cibles. Pour autant, ils ne sont pas les seuls à avoir compris les avantages de cette technologie. Les acteurs de la cybersécurité l’ont également intégrée pour aider les entreprises à mieux se protéger et renforcer leur résilience. Comment l’IA générative est-elle utilisée par les cyberattaquants et les cyberdéfenseurs ? Cet article se propose de faire le point sur l’utilisation de cet outil qui défraye la chronique.

L’IA générative, un outil offensif pour les cyberattaquants

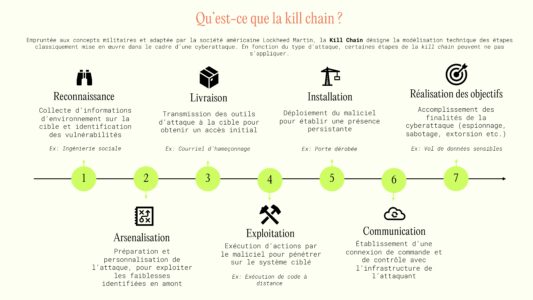

L’IA a commencé à être utilisée par les cyberattaquants en 2020, au moment où l’on a pu observer la démocratisation des IA génératives. Grâce à ses capacités, elle peut être utilisée à toutes les étapes de la kill chain – modèle couramment utilisé pour représenter les étapes et le mode opératoire mis en œuvre au cours d’une cyberattaque.

Reconnaissance et livraison : A cette étape, les cyberattaquants ont souvent recours à l’ingénierie sociale pour identifier les cibles de valeur ou obtenir des informations clés pour la compromettre. L’IA générative peut être utilisée pour réaliser des opérations de phishing, notamment pour envoyer massivement des mails convaincants et adaptés aux victimes. Cette technologie permet donc la convergence de deux approches qui étaient jusqu’ici exclusives : l’hameçonnage massif, avec un faible taux de conversion mais un large volume de cibles, et l’hameçonnage ciblé (ou spearphishing), avec un fort taux de conversion mais un faible volume de cibles. Ces campagnes peuvent inclure des audios ou des deepfakes. On a récemment pu observer ce cas : en janvier 2023, à Hong-Kong, un employé d’un département financier d’une multinationale a été piégé par des attaquants au moyen d’une visioconférence truquée contenant des deepfakes de figures d’autorité de son entreprise, afin de le convaincre de faire un virement de plus de 25 millions de dollars à des cybercriminels.

Les IA génératives peuvent aussi permettre de créer de faux comptes sur les réseaux sociaux, de faux sites et des articles de blog crédibles. Pour les cyberattaquants, cela constitue une opportunité d’améliorer la diffusion de fausses informations, dans le but de déstabiliser une entreprise ou un État. On peut noter que, dans le cadre de l’actuel conflit entre Israël et le Hamas, l’Iran a recours à d’importantes campagnes d’influence dans le but de décrédibiliser le gouvernement israélien et ses opérations militaires, comme le montre l’article Microsoft Security Insider. En effet, un important réseau de « sockpuppets » (comptes sur les réseaux sociaux utilisant une fausse identité ou une identité volée dans le but de diffuser de fausses informations) a été déployé et a recours à l’IA générative pour produire et diffuser du contenu pro-Hamas en se faisant passer pour des internautes israéliens.

Armement : Les IA génératives peuvent être utilisées dans l’amélioration de logiciels malveillants, augmentant ainsi leur sophistication et leur performance. On peut par exemple imaginer une capacité à s’adapter automatiquement au trafic naturel au sein d’un réseau pour s’y fondre, rendant leur détection plus difficile. Et pour les acteurs cybercriminels disposant de peu de connaissances techniques, elle abaisse la barrière à l’entrée nécessaire à la création de maliciels. On peut citer en exemple WormGPT, un outil basé sur l’IA générative, qui permet de générer des cyberattaques par phishing ou email professionnels compromis sophistiquées.

Installation et parallélisation : Les IA génératives disposent de capacités intéressantes en termes de scripting pour rendre plus facile voire dynamique certaines opérations comme : lister les processus en cours sur un ordinateur, adapter ses artefacts au contexte voire trouver des chemins de propagation potentiels à partir d’une machine infectée.

Command & Control : La communication entre le logiciel malveillant et son opérateur pourrait être rendue plus furtive par une IA générative capable de concevoir des requêtes ad hoc et de limiter la détection de patterns. Cela pourrait représenter un gain de furtivité conséquent, surtout combiné à la capacité à imiter une activité réseau standard comme vu plus haut.

Actions sur objectifs : Les capacités des IA génératives peuvent permettre aux logiciels malveillants de présélectionner en autonomie les données de valeur à exfiltrer ou à chiffrer, ce qui limite les flux réseaux ou les opérations suspectes et participe à rendre la détection complexe. Une fois les données exfiltrées, les cyberattaquants gagnent du temps car ils sont en mesure de les analyser rapidement, massivement et en plusieurs langues, ce qui nécessitait auparavant des compétences spécifiques voire des équipes dédiées.

En dehors de cela, l’IA générative peut être utilisée comme un vecteur d’attaque, notamment à des fins de cyberespionnage. En effet, pour le gain d’efficacité qu’elle apporte, l’IA a été intégrée par les entreprises dans leurs process et elle est aujourd’hui utilisée par de nombreux professionnels. Si les entreprises peuvent intégrer des systèmes d’IA propriétaires basés sur des modèles pré-entraînés, elles optent en général pour des modèles d’IA publics, à l’image de ChatGPT. Cela peut être source de vulnérabilité en cas de compromission de serveurs de traitement. En effet, les conversations entre les employés et l’IA peuvent être récupérés par des acteurs malveillants, en raison des informations qu’elles sont susceptibles de contenir : code source interne, informations confidentielles commerciales ou financières, informations destinées à l’authentification sur des systèmes internes…

L’IA générative, un atout pour améliorer la cybersécurité des entreprises

Les cyberattaquants n’ont (heureusement) pas le monopole de l’IA. Sa puissance peut également être utilisée pour contrer la cybermenace. Des entreprises et des organisations gouvernementales l’utilisent déjà, à l’image de la NSA. L’impact de l’IA sur la menace sera compensé par son utilisation pour améliorer la sécurité et la résilience.

Les IA génératives sont aujourd’hui très utilisées dans le milieu de l’éducation, et elles peuvent être une solution efficace pour proposer des formations en cybersécurité personnalisées afin d’améliorer les pratiques des collaborateurs dans ce domaine. Elles participent donc à la prévention du risque cyber au sein des organisations.

Les IA génératives peuvent surtout servir à éviter le risque. Elles peuvent notamment être utilisées pour analyser sa surface d’attaque, notamment humaine, afin de comprendre où se trouve les potentielles failles et ainsi les corriger de façon plus adaptée.

Grâce à l’automatisation de certaines tâches, l’IA permet d’alléger la charge de travail des RSSI et des professionnels de la cybersécurité. Cela ne signifie pas qu’elle va remplacer l’humain, mais plutôt qu’elle va l’appuyer pour qu’il concentre ses efforts sur d’autres tâches pour une meilleure sécurité.

Pour cela, elle peut être utilisée pour des simulations de crise, pour détecter du phishing sur la base du contenu de messages et de pages web, traiter et prioriser des alertes en limitant les faux positifs, simplifier le reporting d’incidents et d’actions de remédiation… En-dehors de cela, les IA génératives peuvent aider à se préparer contre les cyberattaques en étant utilisées lors d’entraînements, pour générer dynamiquement des situations réalistes.

Dans le cadre d’une cyberattaque, l’IA générative peut aider à mettre en place une meilleure communication de crise. Dans des moments où le temps de réaction, le contrôle des éléments de langage et la gestion des émotions s’avèrent critique, une IA peut aider les équipes à formuler rapidement des messages clairs et avoir une meilleure organisation pour rétablir le bon fonctionnement du système d’information.

Dans certains cas, l’IA permet aussi de partager le risque cyber, en obtenant une meilleure couverture assurantielle. Elle peut permettre une modélisation automatique des polices d’assurance et des conditions de partage du risque, afin d’analyser la couverture de son organisation et de faire les meilleurs choix. Les capacités des IA génératives pourraient aussi permettre de générer des conditions générales et particulières d’assurance personnalisées sur la base d’une analyse de risque poussée, comme le suggère le dernier rapport de l’Enisa.

L’IA générative s’est démocratisée en 2023 avec le lancement de ChatGPT. Bien sûr, ses capacités ont su séduire les cyberattaquants, mais elle n’en demeure pas moins un progrès significatif dans l’amélioration de la cybersécurité. Toutefois, elle ne remplacera pas les professionnels de ce secteur mais pourra exercer un rôle d’assistance, notamment dans la détection des cybermenaces ou dans la prise de décisions liée à la sécurité des informations de l’organisation.